Cómo evaluar la sensibilidad de la cámara

Comparación del rendimiento de la cámara usando el estándar de rendimiento de imágenes EMVA1288

Qué contiene:

- Introducción a las mediciones de rendimiento de imágenes en función de EMVA1288

- Definición de las diversas mediciones y cómo se miden

- Comparación del rendimiento de las cámaras con baja iluminación con diferentes tiempos de exposición

- Comparación de un CCD tradicional con un sensor CMOS moderno

- Comparación de las generaciones de sensores Sony Pregius

- Conclusión

Comparar las especificaciones básicas de la cámara como la velocidad de fotogramas, la resolución y la interfaz es fácil. Utilice nuestro nuevo selector de cámara para filtrar y clasificar más de 14 especificaciones EMVA para encontrar la coincidencia exacta para los requisitos de su proyecto. Sin embargo, comprar el rendimiento de las imágenes de las cámaras como la eficiencia cuántica, el ruido oscuro temporal y la capacidad de saturación suele ser un poco más complicado. Primero, debemos entender qué significan realmente estas diversas mediciones.

¿Qué es la eficiencia cuántica y se mide en el pico o en una longitud de onda específica? ¿En qué se diferencia la relación señal/ruido del rango dinámico? Este documento técnico abordará estas cuestiones y explicará cómo comparar y seleccionar cámaras en función de los datos de rendimiento de las imágenes según el estándar EMVA1288.

EMVA1288 es un estándar que define qué aspectos del rendimiento de la cámara se deben medir, cómo medirlos y cómo presentar los resultados en un método unificado. La primera sección del documento técnico ayudará a comprender los diversos aspectos del rendimiento de las imágenes de un sensor de imágenes. Describirá qué conceptos básicos es importante comprender al considerar cómo un sensor de imagen convierte la luz en una imagen digital y, en última instancia, define el rendimiento del sensor. La Figura 1 presenta un solo píxel y resalta estos conceptos.

![]()

Figura 1: Cómo un sensor de imagen convierte la luz en una imagen digital

Primero, debemos entender el ruido inherente a la luz misma. La luz está compuesta de partículas discretas, fotones, generados por una fuente de luz. Debido a que una fuente de luz genera fotones en momentos aleatorios, habrá ruido en la intensidad percibida de la luz. La física de la luz indica que el ruido observado en la intensidad de la luz es equivalente a la raíz cuadrada del número de fotones generados por la fuente de luz. Este tipo de ruido se llama ruido de disparo.

Cabe señalar que el número de fotones observados por un píxel dependerá de los tiempos de exposición y la intensidad de la luz. Este artículo considerará la cantidad de fotones como una combinación del tiempo de exposición y la intensidad de la luz. Del mismo modo, el tamaño del píxel tiene un efecto no lineal en la capacidad de recolección de luz del sensor, ya que esta debe elevarse al cuadrado para determinar el área sensible a la luz. Esto se discutirá con más detalle en el próximo artículo en el contexto de la comparación del rendimiento de dos cámaras.

El primer paso para digitalizar la luz es convertir los fotones en electrones. Este artículo no aborda cómo los sensores hacen esto, sino que presenta la medida de la eficiencia de la conversión. La relación de electrones generados durante el proceso de digitalización con respecto a los fotones se llama Eficiencia cuántica (QE). El ejemplo del sensor de la Figura 1 tiene una QE del 50 % porque se generan 3 electrones cuando 6 fotones “se capturan” en el sensor.

Antes de que los electrones se digitalicen, se almacenan dentro del píxel, conocido como el Pozo. La cantidad de electrones que se pueden almacenar dentro del pozo se llama Capacidad de saturación o Profundidad de pozo. Si el pozo recibe más electrones que la capacidad de saturación, no se almacenarán electrones adicionales.

Una vez que el píxel completa la recolección de luz, se mide la carga en el pozo y esta medición se denomina Señal. La medición de la señal en la Figura 1 está representada por un medidor de flecha. El error asociado con esta medición se llama Ruido oscuro temporal o Ruido de lectura.

Por último, la escala gris se determina convirtiendo el valor de la señal, expresado en electrones, en un valor de unidades analógicas a digitales (ADU) de 16 bits. La relación entre el valor de la señal analógica y el valor de la escala de grises digital se denomina Ganancia y se mide en electrones por ADU. El parámetro de ganancia definido por la norma EMVA1288 no debe confundirse con la ganancia del proceso de conversión “analógico a digital”.

Al evaluar el rendimiento de la cámara, es muy común referirse a la Relación señal/ruido y Rango dinámico. Estas dos medidas de rendimiento de la cámara consideran la relación de ruido observada por la cámara frente a la señal. La diferencia es que el rango dinámico considera solo el ruido oscuro temporal, mientras que la relación señal/ruido también incluye la suma cuadrática media (RMS) del ruido de disparo.

El umbral de sensibilidad absoluta es la cantidad de fotones necesarios para obtener una señal equivalente al ruido observado por el sensor. Esta es una métrica importante porque representa la cantidad mínima teórica de luz necesaria para observar cualquier señal significativa. Los detalles de esta medición se tratarán con más detenimiento en los siguientes artículos.

Para ayudar a comparar los sensores y las cámaras en base al estándar EMVA1288, FLIR creó un estudio integral de la industria sobre el rendimiento de las imágenes de más de 70 modelos de cámaras.

| Medida | Definición | Afectado por | Unidad |

| Ruido de disparo | Raíz cuadrada de la señal | Causado por la naturaleza de la luz | e- |

| Tamaño de píxel | Bueno, tamaño del píxel… | Diseño del sensor | µm |

| Eficiencia cuántica | Porcentaje de fotones que el sensor convierte en electrones en una longitud de onda particular. | Diseño del sensor | % |

| Ruido oscuro temporal (ruido de lectura) | Ruido en el sensor cuando no hay señal | Diseño de la cámara y del sensor | e- |

| Capacidad de saturación (profundidad del pozo) | Cantidad de carga que un píxel puede tener | Diseño de la cámara y del sensor | e- |

| Máxima relación señal/ruido | La relación más alta posible entre una señal y todo el ruido incluido en esa señal, incluido el ruido de disparo y el ruido oscuro temporal ”. | Diseño de la cámara y del sensor | dB, bits |

| Rango dinámico | Relación señal/ruido incluyendosolo el ruido oscuro temporal | Diseño de la cámara y del sensor | dB, bits |

| Umbral de sensibilidad absoluta | Cantidad de fotones necesarios para que la señal sea igual al ruido | Diseño de la cámara y del sensor | Ƴ |

| Ganancia | Parámetro que indica la dimensión de carga necesaria de los electrones para observar un cambio en las ADU de 16 bits (mejor conocido como escala de grises) | Diseño de la cámara y del sensor | e-/ADU |

Comparación del rendimiento de las cámaras con baja iluminación

A los efectos de este documento técnico, consideraremos aplicaciones como el reconocimiento de matrículas (LPR) o el reconocimiento óptico de caracteres (OCR) donde se utilizan comúnmente imágenes monocromáticas y la cantidad de luz que la cámara puede recopilar puede verse limitada debido a los cortos tiempos de exposición. Es bastante sencillo determinar la resolución, la velocidad de fotogramas y el campo de visión necesarios para resolver un problema de imagen, sin embargo, decidir si la cámara tendrá un rendimiento de imagen suficiente puede ser más difícil.

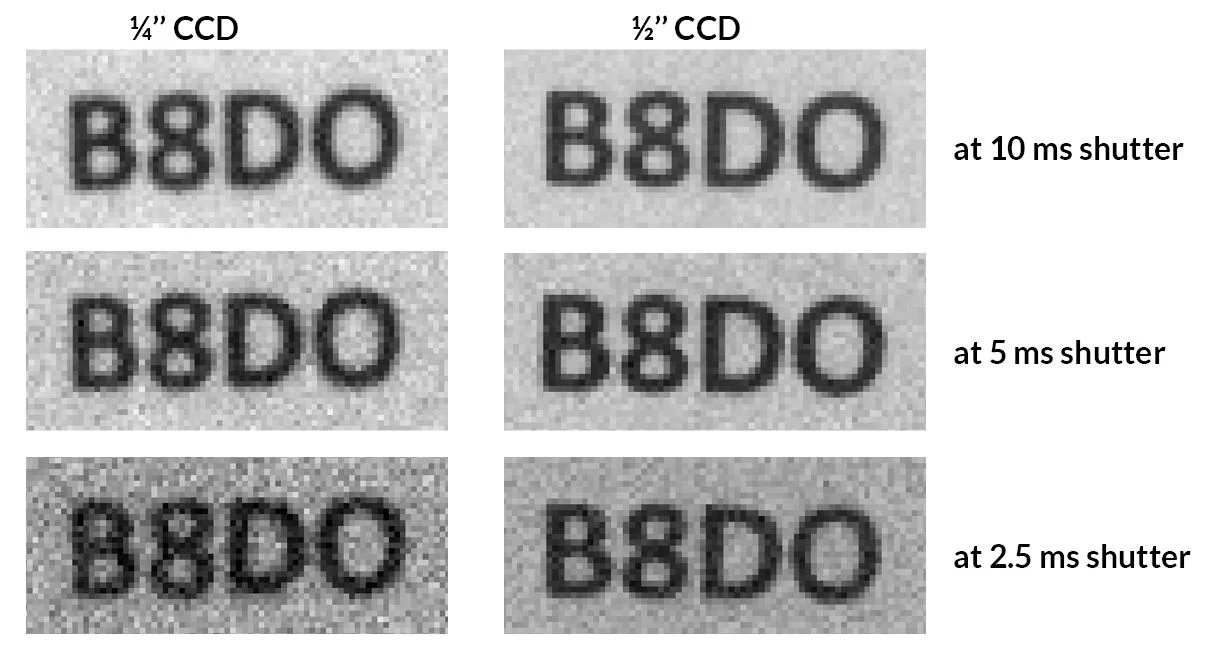

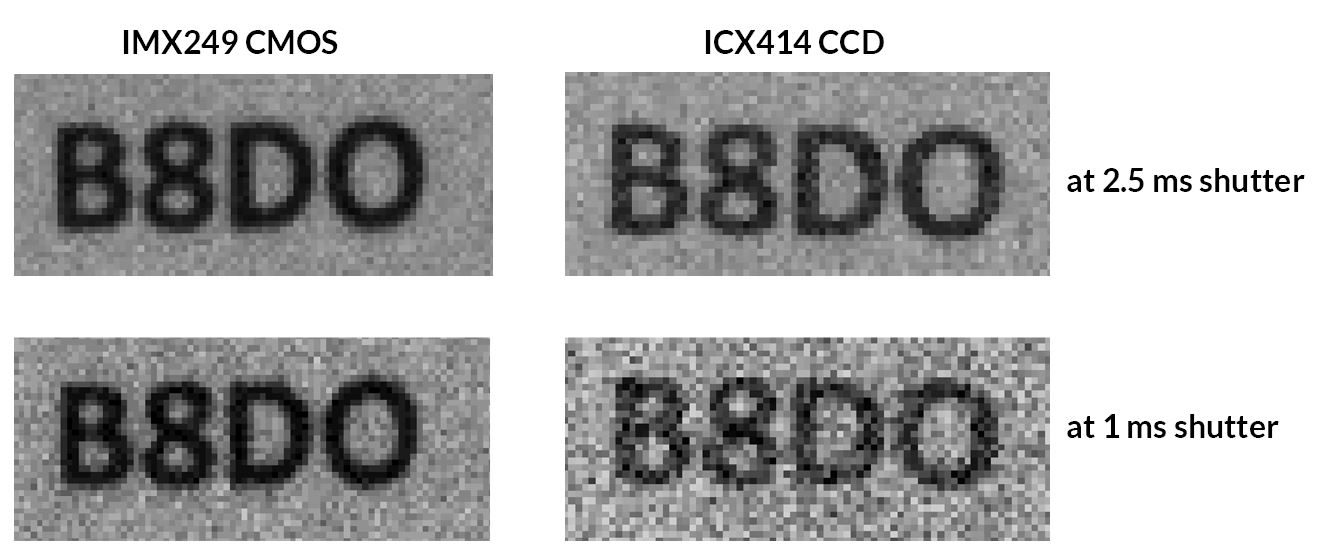

Este desafío generalmente se resuelve por prueba y error. Consideremos un ejemplo en el que un diseñador de sistemas de visión determina que una cámara VGA con un CCD de ¼'' funcionando a 30 FPS es suficiente para la aplicación. Las pruebas iniciales pueden mostrar que la cámara tiene suficiente sensibilidad en tiempos de exposición de 10 ms cuando el objeto está parado. Ver la Figura 2 que muestra un ejemplo simple con los caracteres B, 8, D y 0 que un algoritmo de visión puede confundir fácilmente. La imagen superior izquierda tomada con una cámara con un CCD de ¼” produce imágenes adecuadas para el procesamiento de imágenes.

Figura 2: resultados obtenidos con una cámara con un CCD de 1/4'' y 1/2'' a diferentes tiempos de exposición

Sin embargo, cuando el objeto comienza a moverse, los tiempos de exposición deben reducirse y la cámara no puede proporcionar información útil porque la letra “B” y “D” no se pueden distinguir de los números “8” y “0”. Las imágenes en la parte central e inferior izquierda de la Figura 2 muestran el deterioro de la calidad de la imagen. En particular, el CCD de ¼” con un tiempo de exposición de 2,5 m produce imágenes inadecuadas para el procesamiento de imágenes.

A los fines de este ejemplo, se supone que no se requiere una gran profundidad de campo y, por lo tanto, el número F mínimo de la lente es aceptable. En otras palabras, no es posible recoger más luz abriendo el obturador de la lente.

Entonces, el diseñador necesita considerar una cámara diferente. La pregunta es si una cámara diferente tiene la posibilidad de mejorar el rendimiento del sistema. El uso de un sensor más grande generalmente se ha aceptado como una buena forma de resolver problemas de baja iluminación, por lo que un sensor de ½” podría ser una buena opción. Pero en lugar de continuar con prueba y error, puede ser útil considerar el rendimiento EMVA 1288 de la imagen de la cámara.

| Cámara | Sensor | Tamaño de píxel (μm) | Eficiencia cuántica (%) | Ruido oscuro temporal (e-) | Capacidad de saturación (e-) |

| Cámara 1/4” (FL3-GE-03S1M-C) | ICX618 | 5,6 | 70 | 11,73 | 14,508 |

| Cámara 1/2” (BFLY-PGE-03S3M-C) | ICX414 | 9,9 | 39 | 19,43 | 25.949 |

Al observar los datos de EMVA 1288, se puede ver que el sensor de ¼” tiene una mejor eficiencia cuántica y un menor ruido, pero que el CCD de ½” tiene un píxel de mayor tamaño y una mayor capacidad de saturación. Este artículo muestra cómo determinar si la cámara de ½” tendrá un mejor rendimiento.

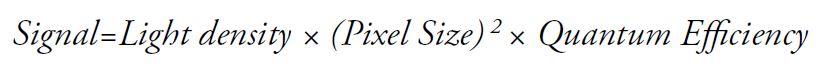

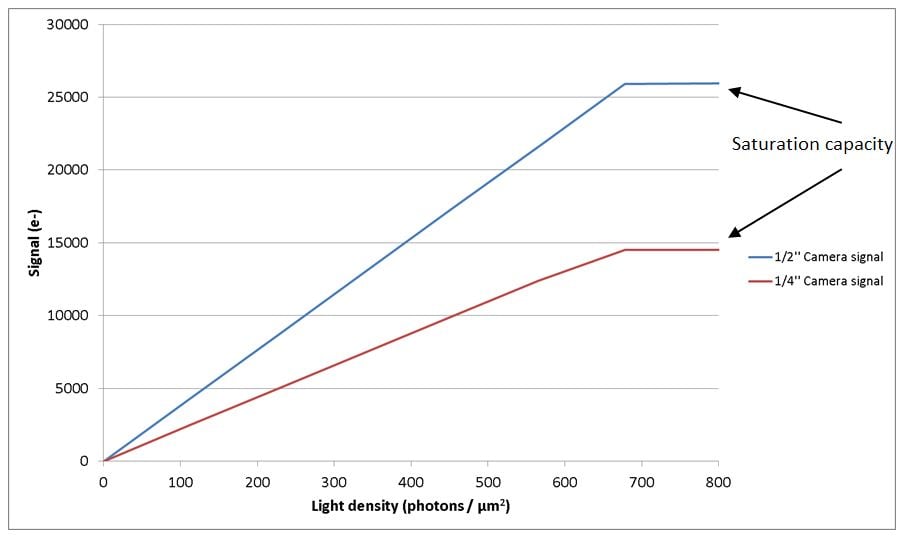

La Figura 3 compara las cámaras al trazar el valor de la señal en función de la densidad de la luz (fotones/μm2). La señal en función de la densidad de la luz se determina usando la siguiente fórmula:

Una suposición importante hecha por este artículo es que las lentes tienen el mismo campo de visión, el mismo número F y la misma configuración de cámara.

Figura 3: señal producida por cámaras con un CCD de 1/4'' y 1/2'' como una función del nivel de luz

Regístrese para leer más artículos como este

La figura muestra que para la misma densidad de luz, el sensor de ½” generará una señal más alta. También se puede observar que la saturación ocurre a un nivel de densidad de luz similar de 700 fotones/μm2, sin embargo, el sensor de ½” tiene una capacidad de saturación significativamente más alta.

En la aplicación que se considera en este documento, la comparación de cámaras debe realizarse con poca luz. Por lo tanto, tener en cuenta los niveles de ruido se vuelve particularmente importante.

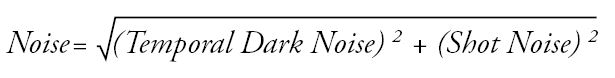

La Figura 4 muestra la señal y el ruido a bajos niveles de iluminación. El ruido presentado en la figura es una suma RMS de ruido oscuro temporal y ruido de disparo que se calculó usando la siguiente fórmula:

Figura 4: señal y ruido de las cámaras con un CCD de 1/4'' y 1/2'' con niveles de luz bajos

El gráfico muestra que el umbral de sensibilidad absoluta (el nivel de luz a la cual la señal es igual al ruido) es alcanzado por el sensor de ½” a un nivel ligeramente más bajo que el del sensor de ¼”. La medida más importante que se necesita para determinar qué cámara funcionará mejor en aplicaciones con poca luz es la relación señal/ruido (SNR).

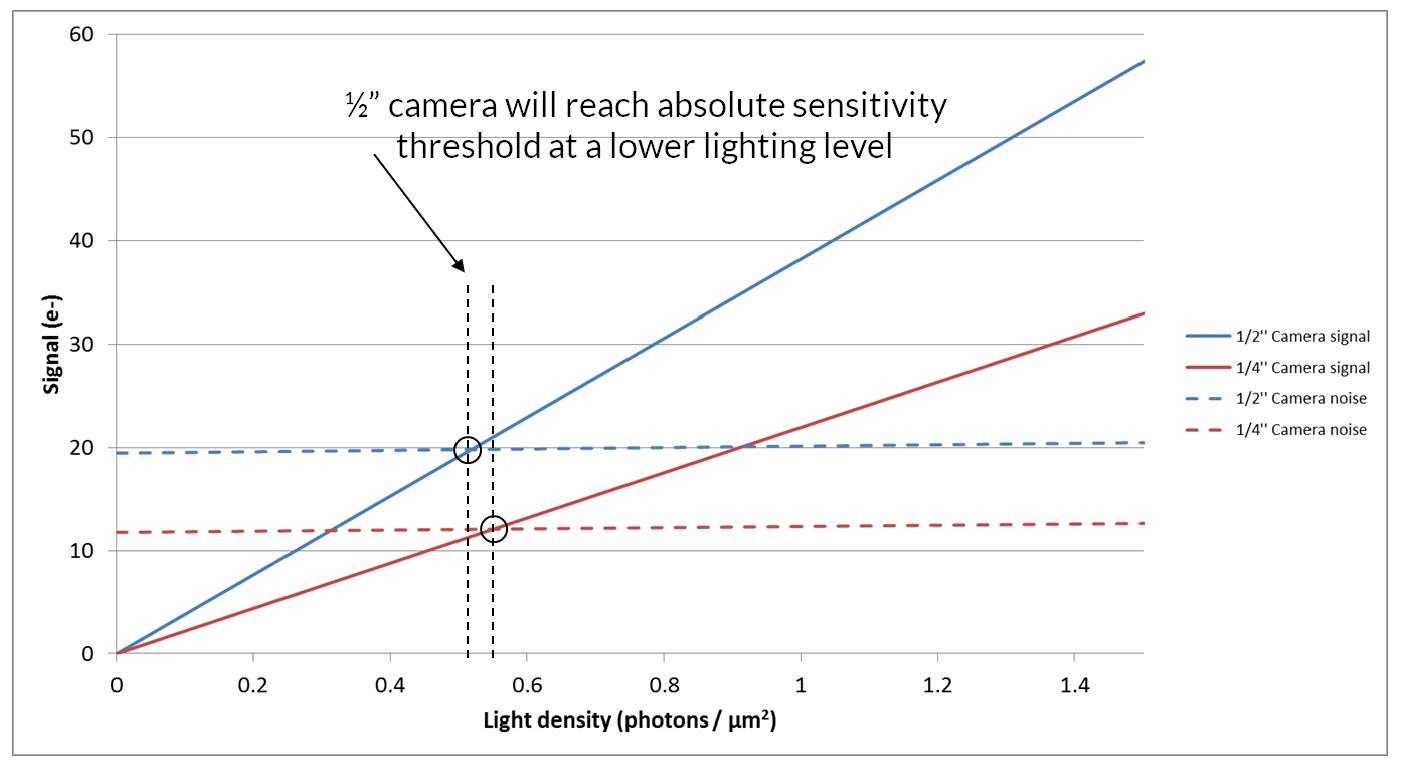

La Figura 5 muestra la SNR de las dos cámaras en función del nivel de iluminación.

Figura 5: relación señal/ruido de las cámaras con un CCD de 1/4” y 1/2” con niveles de luz bajos

Sobre la base de la relación señal/ruido más alta del sensor de ½”, la teoría sugiere que las cámaras de ½” deben funcionar mejor que la cámara de ¼” con niveles de luz bajos.

De las imágenes de la Figura 2, se puede observar que con un tiempo de exposición de 2,5 m, el sensor de ½” conserva la forma de los caracteres en todos los tiempos de exposición, mientras que el sensor de ¼” hace que sea difícil distinguir entre caracteres. Por lo tanto, el sensor de ½” funciona mejor y los resultados prácticos están en línea con la teoría.

FLIR ha realizado un amplio estudio de las cámaras y ha publicado los resultados del rendimiento de imágenes EMVA 1288. Esta información se puede usar para comparar el rendimiento de diferentes modelos de cámara. Si bien la implementación de la cámara no influye en el rendimiento de la imagen, este estudio puede ser útil en general cuando se comparan dos cámaras cualquiera con los sensores incluidos en el documento.

FLIR ofrece documentos específicos de comparación de cámaras. Comunicarse a [email protected] para solicitar una comparación entre los modelos de cámara de FLIR.

Cabe señalar que el método descrito en este documento técnico es útil para tener una idea general de lo bien que funcionará una cámara en comparación con otra. Este método puede ayudar a descartar cámaras que probablemente no mejorarán el rendimiento requerido, sin embargo, la prueba definitiva del rendimiento de la cámara se encuentra en la aplicación real.

Comparación de un CCD tradicional con un sensor CMOS moderno

Ahora compararemos el rendimiento de un sensor CCD tradicional con un sensor CMOS moderno en condiciones de baja iluminación y en una escena con una amplia gama de condiciones de iluminación.

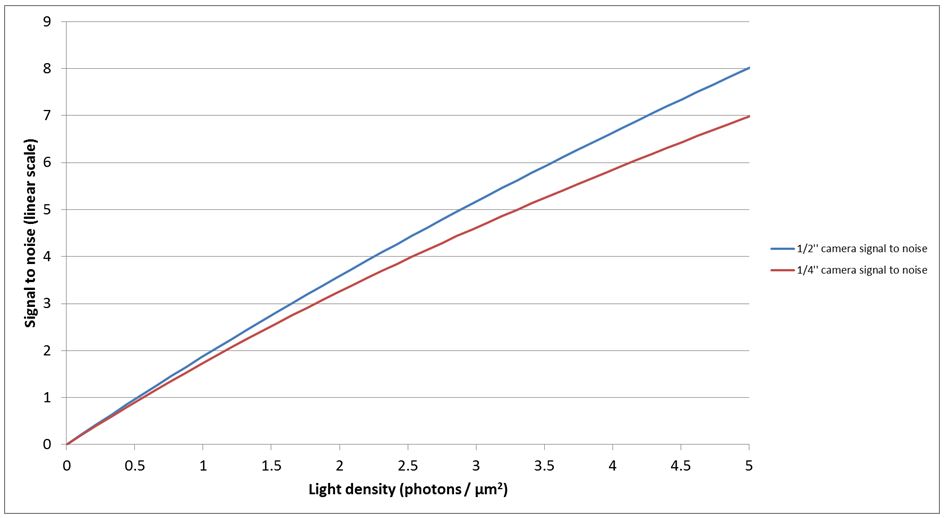

En la sección anterior mostramos que una cámara Sony ICX414, con un CCD VGA de ½”, funciona mejor en condiciones de poca luz que una cámara Sony ICX618, con un CCD VGA de ¼”. Ahora vamos a comparar el sensor CCD VGA de ½” con el nuevo sensor CMOS de obturador global Sony Pregius IMX249, 1/1,2” 2,3 Mpix.

A primera vista, esto puede parecer una comparación entre “manzanas y naranjas”, sin embargo, el costo de las cámaras con estos dos sensores es comparable en aproximadamente €400, una región VGA de interés en la cámara CMOS está más cerca del tamaño óptico de la cámara de ¼” y las velocidades de cuadro también son similares en resolución VGA.

Los datos de EMVA 1288 para las cámaras muestran que el sensor CMOS IMX249 tiene una eficiencia cuántica significativamente mejor, menos ruido y una mayor capacidad de saturación. Por otro lado, el sensor CCD ICX414 tiene un píxel más grande, que era el parámetro crítico en el ejemplo presentado en el artículo anterior.

| Cámara | Sensor | Tamaño de píxel (μm) | Eficiencia cuántica (%) | Ruido oscuro temporal (e-) | Capacidad de saturación (e-) |

| Cámara CCD de 1/2” (BFLY-PGE-03S3M-C) | ICX414 | 9,9 | 39 | 19,43 | 25,949 |

| Cámara CMOS de 1/1,2” (BFLY-PGE-23S6M-C) | IMX249 | 5,86 | 80 | 7,11 | 33,105 |

Figura 6: relación señal/ruido de los sensores CCD ICX414 y CMOS IMX249 con niveles de luz bajos

Figura 7: resultados obtenidos de los sensores CCD ICX414 y CMOS IMX249 con diferentes tiempos de exposición

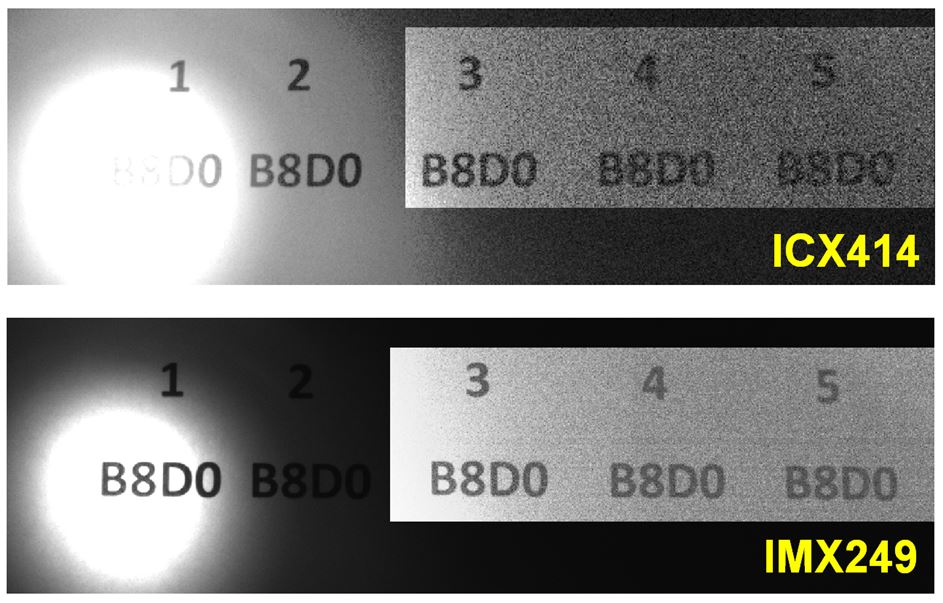

La comparación más interesante se da a mayores intensidades de luz debido a la diferencia en la capacidad de saturación entre los dos sensores. La Figura 8 muestra la señal como una función de la intensidad de la luz en todo el rango de intensidades de luz. Del gráfico se puede observar que el sensor CCD ICX414 alcanzará la capacidad de saturación a alrededor de 700 fotones/μm2, mientras que el sensor CMOS IMX249 se saturará a más de 1200 fotones/μm2.

Figura 8: señal producida por los sensores CCD ICX414 y CMOS IMX249 en función del nivel de luz

La primera conclusión que se puede hacer es que la imagen producida por el sensor CCD ICX414 será más brillante que la imagen producida por el sensor CMOS IMX249. Si esto no es obvio al observar el gráfico, considere la imagen que se produciría a alrededor de 700 fotones/μm2. En el caso del sensor CCD ICX414, la imagen debría estar en los niveles más altos de la escala de grises, muy probablemente saturada, mientras que el sensor CMOS IMX249 produciría una imagen que está justo por encima del 50% del brillo máximo. Esta observación es importante porque un enfoque ingenuo para evaluar la sensibilidad de la cámara es observando el brillo de la imagen. En otras palabras, la suposición es que una imagen más brillante será producida con una cámara con un mejor rendimiento. Sin embargo, esto no es cierto y en este ejemplo, en realidad, es todo lo contrario, la cámara que produce imágenes más oscuras en realidad tiene un mejor rendimiento.

Figura 9: resultados obtenidos con los sensores CCD ICX414 y CMOS IMX249 en condiciones de iluminación difíciles

La segunda observación es que el sensor CMOS IMX249 producirá imágenes que son útiles para el procesamiento de imágenes en una amplia gama de condiciones de iluminación. La Figura 9 muestra la misma escena capturada por las dos cámaras. Se debe tener en cuenta que la parte más oscura de las imágenes se ha mejorado para fines de visualización, sin embargo, los datos subyacentes no se modificaron. De las imágenes se puede observar que el CCD ICX414 se satura en las áreas brillantes de la escena, mientras que al mismo tiempo tiene demasiado ruido en las áreas oscuras para que los personajes sean legibles. Por el contrario, el sensor CMOS IMX249 produce caracteres legibles en las partes brillantes y oscuras de la escena.

Finalmente, podemos concluir que la reciente tecnología CMOS de obturadores globales se está convirtiendo en una alternativa viable a los CCD en aplicaciones de visión artificial. Los sensores no solo son menos costosos, tienen velocidades de cuadros mayores a resoluciones equivalentes, y no tienen artefactos como manchas e hiperluminosidad, sino que también están comenzando a exceder el rendimiento de las imágenes de los CCD.

Comparación de las generaciones de Sony Pregius

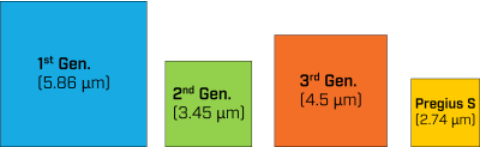

Como dijimos en la sección anterior, el tamaño del sensor impacta enormemente en su rendimiento debido al hecho de que los píxeles más grandes permiten que se les coloque una cantidad máxima de fotones más alta, así como también es posible recoger más fotones en la misma condición de iluminación. La desventaja por tener un tamaño de píxel más grande es que el tamaño del sensor deberá ser más grande para adaptarse a una resolución dada, en comparación con usar un sensor con tamaño de píxel más pequeño, que aumenta el costo del sensor. La siguiente figura muestra cómo cambió el tamaño del píxel entre diferentes generaciones de sensores Sony Pregius.

Figura 10: diferencias de tamaño de píxel entre diferentes generaciones de sensores Sony Pregius

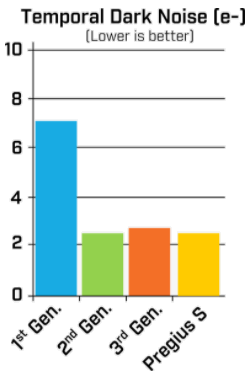

A pesar de la tendencia descendente del tamaño del píxel (además de la tercera generación del sensor), el rendimiento del procesamiento de imágenes del sensor aumentó, excepto por la capacidad del sensor, con cada generación. Un motivo importante para la mejora del rendimiento del procesamiento de imágenes es el bajo ruido oscuro temporal del sensor que se encuentra desde la segunda generación. La siguiente figura muestra cómo el ruido oscuro temporal del sensor progresó a través de las diferentes generaciones del sensor Pregius.

Figura 11: Pregius S mantiene un bajo nivel de ruido de lectura

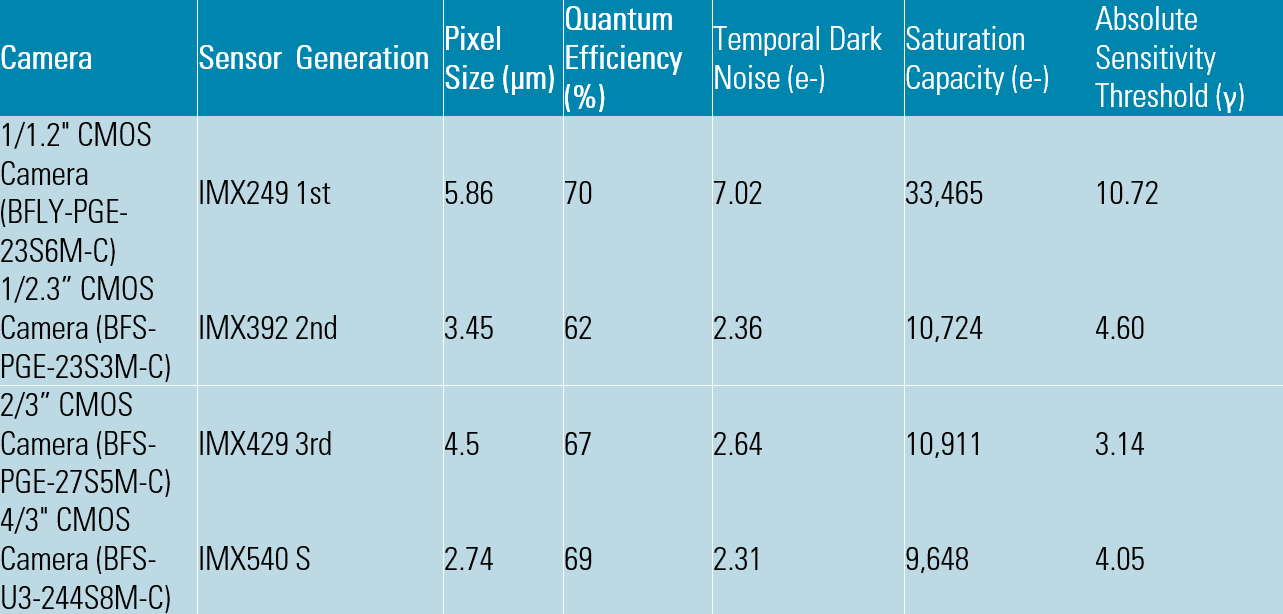

Para obtener una vista completa del rendimiento del procesamiento de imágenes del sensor, consulte la siguiente tabla para ver la especificación del sensor representativo de cada generación de Pregius.

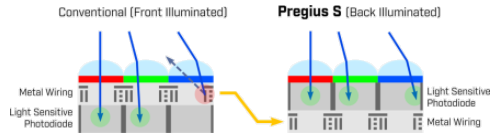

Al observar la tabla anterior, se puede ver que a pesar de tener el menor tamaño de píxel, el rendimiento del procesamiento de imágenes del sensor Pregius S es comparable con sensores de la segunda y tercera generación. Esto se debe al diseño de iluminación posterior del sensor que permite un ángulo más amplio de entrada para el fotón que ayuda a capturar más luz dentro del píxel.

Figura 12: los sensores BSI invierten el diseño tradicional del sensor de iluminación frontal, lo que hace que los fotones se introduzcan más fácilmente en el fotodiodo sensible a la luz de cada píxel

Este nuevo diseño de sensor permite que la familia de sensores Pregius S mantenga el rendimiento del procesamiento de imágenes de las generaciones anteriores, al tiempo que utiliza el píxel más pequeño hasta el momento, lo cual da como resultado sensores con mayor resolución a precios relativamente bajos.

Conclusión

En este documento técnico, aprendimos los conceptos clave utilizados para evaluar el rendimiento de la cámara. Presentamos el estándar EMVA1288 y aplicamos los resultados para comparar el rendimiento de la cámara en una variedad de condiciones de iluminación. Todavía hay muchos más aspectos del rendimiento de la cámara que se pueden considerar al evaluar cámaras. Por ejemplo, la eficiencia cuántica cambia drásticamente a diferentes longitudes de onda, por lo que una cámara que funciona bien a 525 nm, puede no funcionar igual cuando la fuente de luz está en frecuencias carcanas a la luz infrarroja (NIR). De manera similar, los largos tiempos de exposición comunes a la fluorescencia y la captura de imágenes astronómicas deben considerar los efectos de la corriente oscura, un tipo de ruido que es importante a niveles de luz extremadamente bajos.

No es fácil elegir la cámara adecuada en función de las características de rendimiento de la imagen, sin embargo, esperamos que este documento técnico haya ayudado un poco a dar sentido a este tema fascinante y complejo.

Filtre y clasifique usando más de 14 especificaciones EMVA para encontrar la coincidencia exacta para los requisitos de su proyecto – Pruebe nuestro nuevo selector de cámara.